Introduction

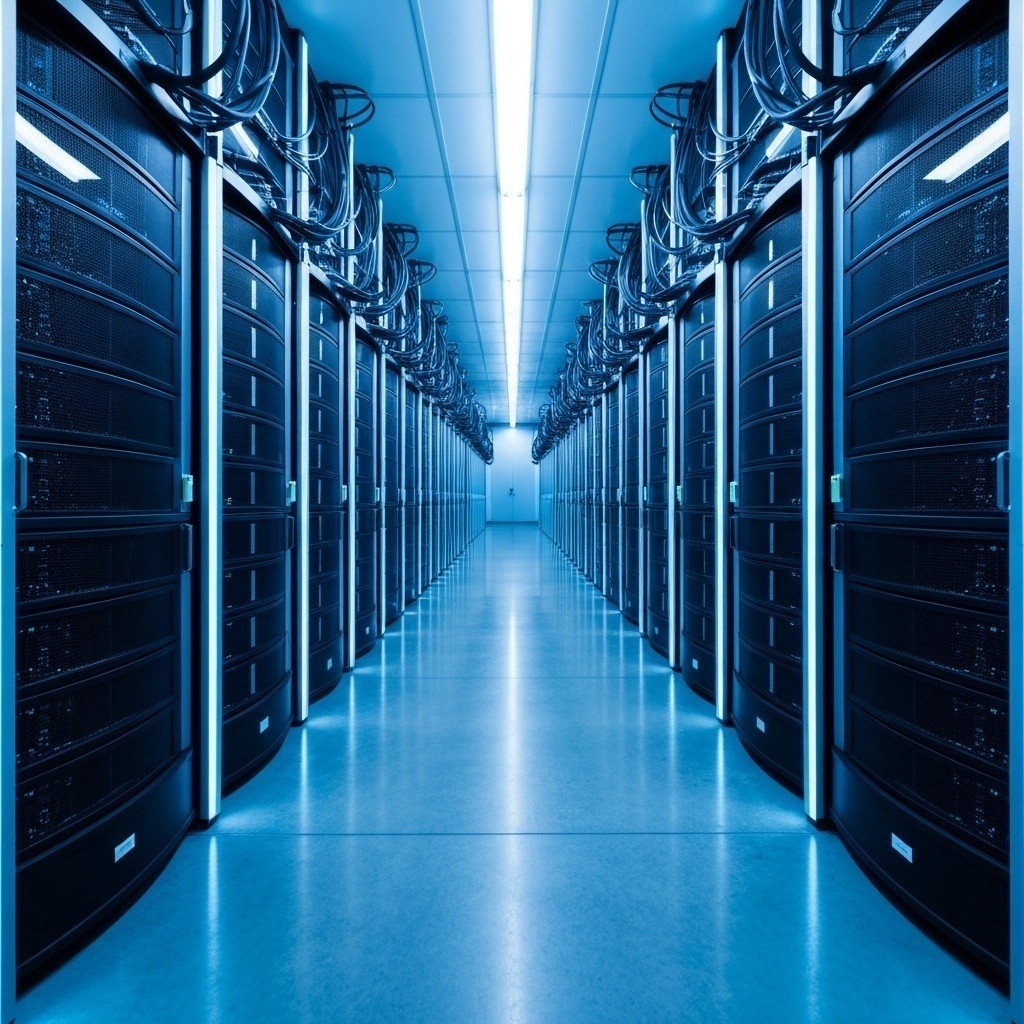

La récupération de données sur serveurs est devenue un impératif stratégique pour toute organisation connectée. Elle ne se limite plus à la simple sauvegarde : elle conditionne la résilience opérationnelle, la capacité à maintenir les services critiques et à protéger la réputation de l’entreprise. Une défaillance serveur non maîtrisée peut entraîner des pertes financières majeures, des interruptions de production, des sanctions réglementaires et une érosion durable de la confiance des clients et partenaires.

Les incidents ont des causes multiples : panne matérielle, corruption logicielle, cyberattaque, erreur humaine ou catastrophe naturelle. Pour y faire face, un plan de récupération serveur rigoureux doit préciser qui intervient, selon quelles procédures et avec quels objectifs de temps de rétablissement. Il couvre l’ensemble du cycle de vie des données : sauvegarde, réplication, test régulier des restaurations et amélioration continue à partir des incidents observés.

La complexité croissante des infrastructures hybrides, combinant serveurs physiques, environnements virtualisés et ressources cloud, impose une approche proactive et adaptative. Les méthodes traditionnelles de sauvegarde nocturne et de restauration manuelle ne suffisent plus dans un contexte de volumétrie massive, d’exigence de disponibilité 24/7 et de réduction des fenêtres de maintenance. L’intelligence artificielle, le machine learning, la virtualisation avancée et le cloud computing ouvrent la voie à une récupération serveur plus rapide, plus fiable et largement automatisée.

Technologies Serveur

La diversité des technologies serveur influe directement sur les stratégies de récupération de données. Les serveurs physiques restent indispensables pour certaines applications critiques (bases de données sensibles, systèmes industriels, environnements réglementés) qui exigent un contrôle complet du matériel. Leur récupération suppose souvent des interventions de bas niveau : extraction de disques, imagerie sectorielle de supports défaillants, analyse des secteurs instables et reconstruction des structures logiques à partir de fragments cohérents.

Les environnements virtualisés (VMware, Hyper-V, Proxmox, etc.) offrent une souplesse bien supérieure grâce aux snapshots, à la réplication et aux fonctions de haute disponibilité. Néanmoins, une corruption de machine virtuelle peut affecter l’image disque, le fichier de configuration ou même l’hyperviseur sous-jacent. La récupération nécessite alors une analyse structurée de chaque couche : stockage physique, datastore, fichiers VMDK/VHDX, système de fichiers invité et services applicatifs.

Les systèmes de stockage en réseau (NAS/SAN) sont devenus centraux pour répondre aux besoins croissants de capacité et de performance. Ils s’appuient sur des niveaux RAID variés (0, 1, 5, 6, 10, etc.) et sur des systèmes de fichiers avancés (NTFS, EXT4, XFS, ZFS). Chaque combinaison impose des contraintes spécifiques en cas d’incident. La reconstruction d’un RAID 5 après la perte d’un disque, par exemple, s’appuie sur les informations de parité, tandis qu’un RAID 6 tolère deux défaillances mais complique le calcul de réintégration. La fragmentation, les blocs défectueux ou une configuration RAID déclarée à tort peuvent compromettre définitivement les données si la procédure n’est pas parfaitement maîtrisée.

Le système d’exploitation serveur conditionne également les méthodes de récupération. Sous Windows Server, les outils natifs (Windows Server Backup, VSS, clustering, réplication) permettent d’orchestrer sauvegardes applicatives, points de restauration et bascules automatiques. Dans l’univers Linux (Red Hat, CentOS, Ubuntu, Debian, etc.), l’administrateur dispose d’un vaste écosystème open source : ddrescue pour l’imagerie de disques instables, TestDisk et PhotoRec pour la reconstruction de partitions et de fichiers, LVM pour la gestion souple des volumes logiques. La maîtrise de la ligne de commande et des journaux système est ici un facteur clé de succès.

Les bases de données (SQL Server, Oracle, MySQL, PostgreSQL, entre autres) posent un défi supplémentaire, car elles exigent le respect strict de l’intégrité transactionnelle. Un plan de sauvegarde performant combine généralement sauvegardes complètes, incrémentielles et différentielles, ainsi que l’exploitation des journaux de transactions pour effectuer des restaurations à un instant donné (« point-in-time recovery »). La réussite d’une opération de récupération passe par la compréhension fine des mécanismes internes de chaque moteur (journaux redo, rollback segments, index, métadonnées) et par des tests réguliers de scénarios de panne réalistes.

L’adoption massive de la virtualisation et de la conteneurisation (Docker, Kubernetes, OpenShift, etc.) introduit enfin de nouveaux cas d’usage. Dans ces environnements dynamiques, les charges de travail se déplacent, se répliquent et se redéploient en quelques secondes. Une stratégie de récupération efficace doit distinguer les éléments éphémères (conteneurs, caches) des données persistantes (volumes, bases de données, objets stockés) et prévoir pour chacun des mécanismes de sauvegarde, de versionning et de restauration cohérents.

Méthodes Innovantes

L’innovation en matière de données transforme en profondeur les stratégies de récupération serveur, en les rendant plus intelligentes, automatisées et prédictives. L’intelligence artificielle (IA) et le machine learning (ML) analysent en continu les journaux système, les métriques de performance et les événements de sécurité pour détecter des signaux faibles de défaillance. Une hausse anormale des erreurs d’E/S, une latence disque qui dérive ou une augmentation brutale des tentatives de connexion échouées peuvent ainsi déclencher des alertes précoces et orienter automatiquement les actions correctives.

Couplée à ces technologies prédictives, l’automatisation joue un rôle central. Des moteurs d’orchestration peuvent, par exemple, déclencher la création d’un snapshot avant une mise à jour sensible, basculer une charge de travail vers un site de secours en cas de dégradation de performance, ou lancer une restauration ciblée sur un sous-ensemble de données compromis. Cette exécution normalisée, documentée et répétable réduit la dépendance aux interventions manuelles et limite les risques d’erreur humaine lors d’un incident critique.

Le cloud computing constitue un autre pilier des méthodes innovantes de récupération. Les services de stockage objet comme AWS S3, Azure Blob Storage ou Google Cloud Storage offrent une forte durabilité, une redondance géographique et des mécanismes de versionning utiles contre les suppressions ou modifications malveillantes. Intégrés à un plan de reprise d’activité (PRA/DRP), ils permettent de répliquer des serveurs complets et de redéployer une infrastructure de secours en quelques minutes, sans immobiliser un second site physique à plein temps.

Les technologies de virtualisation modernes renforcent encore ces capacités. Les snapshots cohérents applicativement, la réplication asynchrone ou synchronisée de machines virtuelles vers un site distant et la migration en direct réduisent drastiquement le temps de bascule lors d’une panne. Des plateformes telles que VMware vSphere ou Microsoft Hyper-V intègrent nativement des fonctions de sauvegarde granulaire, de récupération instantanée et de test de PRA en environnement isolé, sans perturber la production.

La conteneurisation, avec Docker et Kubernetes, impose un changement de paradigme : l’on ne cherche plus seulement à restaurer un serveur entier, mais à reconstruire rapidement un ensemble de services. Les images de conteneurs, stockées dans des registres sécurisés, peuvent être redéployées à la demande, tandis que les mécanismes d’auto-guérison de Kubernetes relancent automatiquement les pods défaillants. La résilience passe alors par la conception d’applications stateless et par l’externalisation des données persistantes dans des volumes répliqués et sauvegardés de manière indépendante.

La surveillance proactive, enfin, constitue la fondation de toute démarche moderne de récupération. Des outils comme Nagios, Zabbix, Prometheus ou des solutions APM (Application Performance Monitoring) collectent en temps réel des milliers d’indicateurs : CPU, mémoire, IOPS, latence réseau, taux d’erreurs applicatives, etc. Couplés à des algorithmes d’anomalie basés IA, ils permettent de détecter les dérives avant la panne, de documenter les incidents et d’alimenter un retour d’expérience continu. Les techniques de déduplication et de compression intégrées aux chaînes de sauvegarde complètent ce dispositif en réduisant les volumes stockés, les fenêtres de sauvegarde et les coûts globaux de stockage.

Applications Pratiques

Les approches innovantes de récupération de données prennent toute leur valeur lorsqu’elles sont appliquées à des cas concrets. Qu’il s’agisse de serveurs modernes hautement virtualisés, de baies RAID très sollicitées ou d’environnements hybrides, une mise en œuvre rigoureuse permet de réduire fortement les temps d’arrêt, de limiter les pertes de données et d’améliorer la prévisibilité des opérations de reprise.

Serveurs Modernes

- Diagnostic avancé : exploitation d’outils d’analyse prédictive et de télémétrie pour identifier de manière proactive les défaillances potentielles (surchauffe, dégradation SMART, fuites mémoire, pics d’E/S anormaux). L’analyse croisée des logs système, des journaux d’événements applicatifs et des indicateurs de performance permet de détecter les signes avant-coureurs d’incident et de planifier des interventions préventives (remplacement de disques, correctifs logiciels, réallocation de ressources) avant l’interruption de service.

Techniques Avancées

- Récupération RAID : reconstruction de configurations RAID endommagées en s’appuyant sur une compréhension fine des niveaux RAID (0, 1, 5, 6, 10) et de leurs algorithmes de parité. Dans le cas d’un RAID 5 avec disque défaillant, par exemple, l’usage d’outils spécialisés permet de réassembler virtuellement les disques, de recalculer les blocs manquants à partir de la parité et de réparer les métadonnées corrompues. Des techniques forensiques avancées sont mises en œuvre pour traiter les dommages logiques (système de fichiers endommagé, effacements accidentels, reconfiguration malencontreuse du RAID) tout en préservant l’intégrité probatoire des données.

Résultats

- Automatisation : déploiement de scripts et de chaînes d’orchestration pour accélérer les opérations de récupération et garantir leur répétabilité. Par exemple, un script PowerShell ou Bash peut automatiser la restauration de jeux de données critiques à partir d’instantanés validés, la remise en ligne contrôlée de services dépendants et la vérification post-restauration. Couplée à des outils de gestion de configuration (Ansible, Puppet, Chef), cette automatisation assure la cohérence de l’environnement rétabli, réduit le temps moyen de rétablissement (MTTR) et libère les équipes pour des tâches à plus forte valeur ajoutée.

Conclusion

Dans un paysage numérique en constante mutation, la récupération de données sur serveurs constitue un enjeu de survie pour les entreprises. Elle requiert une expertise pointue, une veille technologique permanente et une capacité à intégrer rapidement les innovations (IA, cloud, conteneurs, virtualisation) dans des processus industrialisés et documentés. La faculté à restaurer rapidement les services après un incident, qu’il s’agisse d’une erreur humaine isolée ou d’une catastrophe majeure, conditionne directement la pérennité et la compétitivité de l’organisation.

Pour être efficace, une stratégie de récupération serveur doit s’inscrire dans une démarche globale de gestion des risques : classification des données, analyse d’impact sur l’activité, définition d’objectifs de temps de rétablissement (RTO) et d’objectifs de point de récupération (RPO) réalistes, documentation claire des procédures et tests réguliers de scénarios de crise. Les plans de sauvegarde et de reprise ne valent que s’ils sont éprouvés, mesurés et améliorés en continu.

Datastrophe se positionne comme un partenaire de confiance pour accompagner cette transformation. Nos équipes spécialisées en récupération serveur combinent retour d’expérience terrain, compétences avancées en forensics et maîtrise des environnements physiques, virtuels et cloud. Nous proposons des diagnostics d’infrastructure, des recommandations personnalisées et des interventions ciblées pour garantir une récupération rapide, fiable et sécurisée de vos données. Contactez-nous pour bénéficier d’une évaluation de vos dispositifs actuels et construire, ensemble, une stratégie de protection et de résilience adaptée à vos enjeux.