Introduction

La technologie de précision est devenue un socle incontournable pour la recherche scientifique, l’industrie manufacturière et les infrastructures numériques. En réduisant au minimum les marges d’erreur, elle garantit la cohérence des résultats et la fiabilité des systèmes, depuis la fabrication d’un composant électronique jusqu’à la sauvegarde d’une base de données critique. Cette maîtrise du détail crée un environnement idéal pour l’innovation, la décision fondée sur les données et la récupération de données en cas d’incident.

L’essor de la technologie de précision repose sur la capacité à mesurer, manipuler et contrôler des phénomènes à des échelles de plus en plus fines, du nanomètre au qubit. En laboratoire comme en production, ces technologies permettent de relier le monde physique au monde numérique : chaque valeur mesurée, chaque échantillon analysé, chaque bit stocké devient une donnée traçable et exploitable. Sans cette discipline de la précision, la « récupération de données » perdrait une grande partie de son sens, faute d’informations fiables à restaurer.

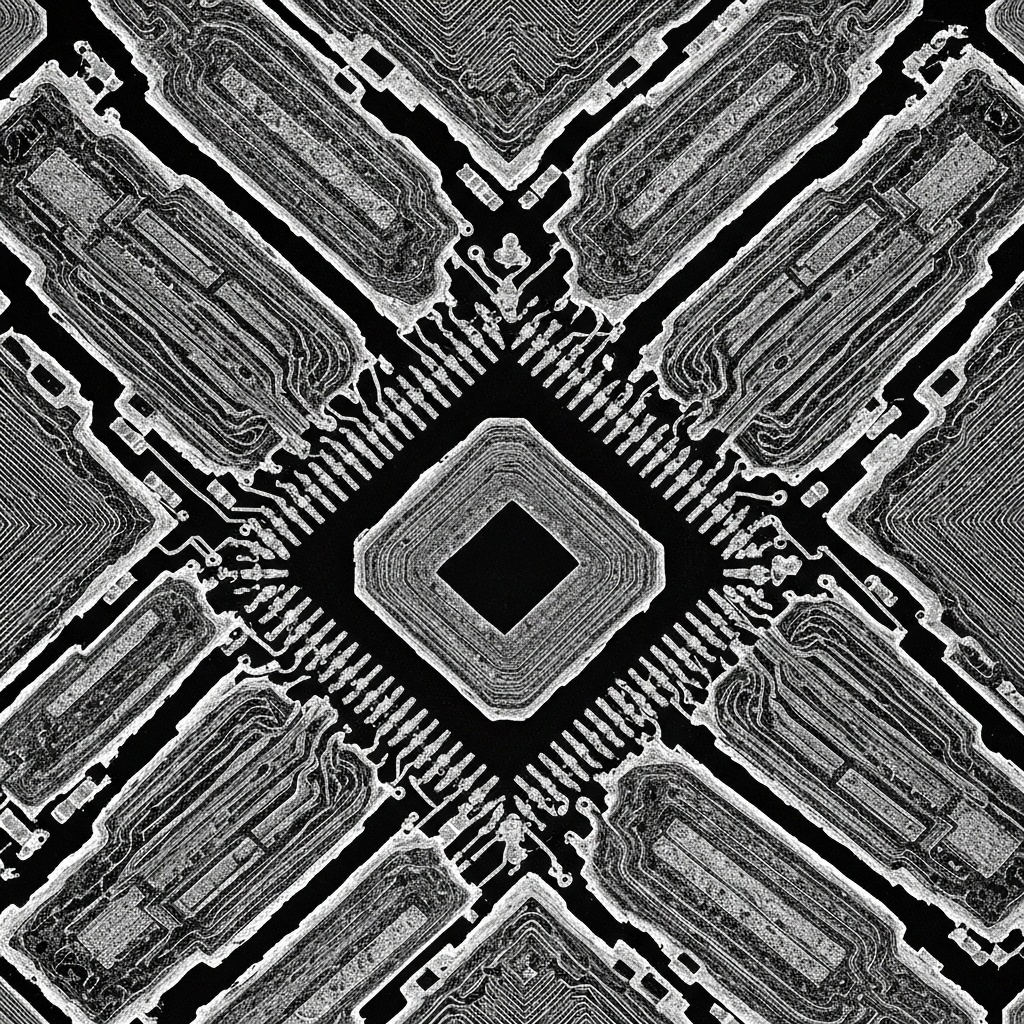

Prenons l’exemple de la gravure de microcircuits : la précision y est souveraine. Chaque transistor et chaque interconnexion doivent être positionnés et dimensionnés avec une exactitude extrême, sous peine de rendre un lot entier inutilisable. Cette même exigence s’applique aux infrastructures de stockage et de traitement de l’information : la moindre fluctuation non maîtrisée peut altérer un signal, corrompre un fichier ou compromettre une chaîne d’acquisition. C’est parce que les processus sont conçus avec une technologie de précision que les opérations de sauvegarde et de récupération de données peuvent restituer fidèlement l’information d’origine.

Outils de Précision

La quête de précision s’appuie sur une panoplie d’outils de précision sophistiqués, conçus pour mesurer, manipuler et piloter la matière ou l’information à très fine échelle. Capteurs intelligents, systèmes de mesure interférométriques, robots de manipulation microscopique ou plateformes d’acquisition de données haute fréquence contribuent à capturer des signaux fidèles à la réalité. Plus les instruments sont précis, plus la donnée produite est exploitable pour la modélisation, le contrôle de qualité et, à terme, la récupération de données.

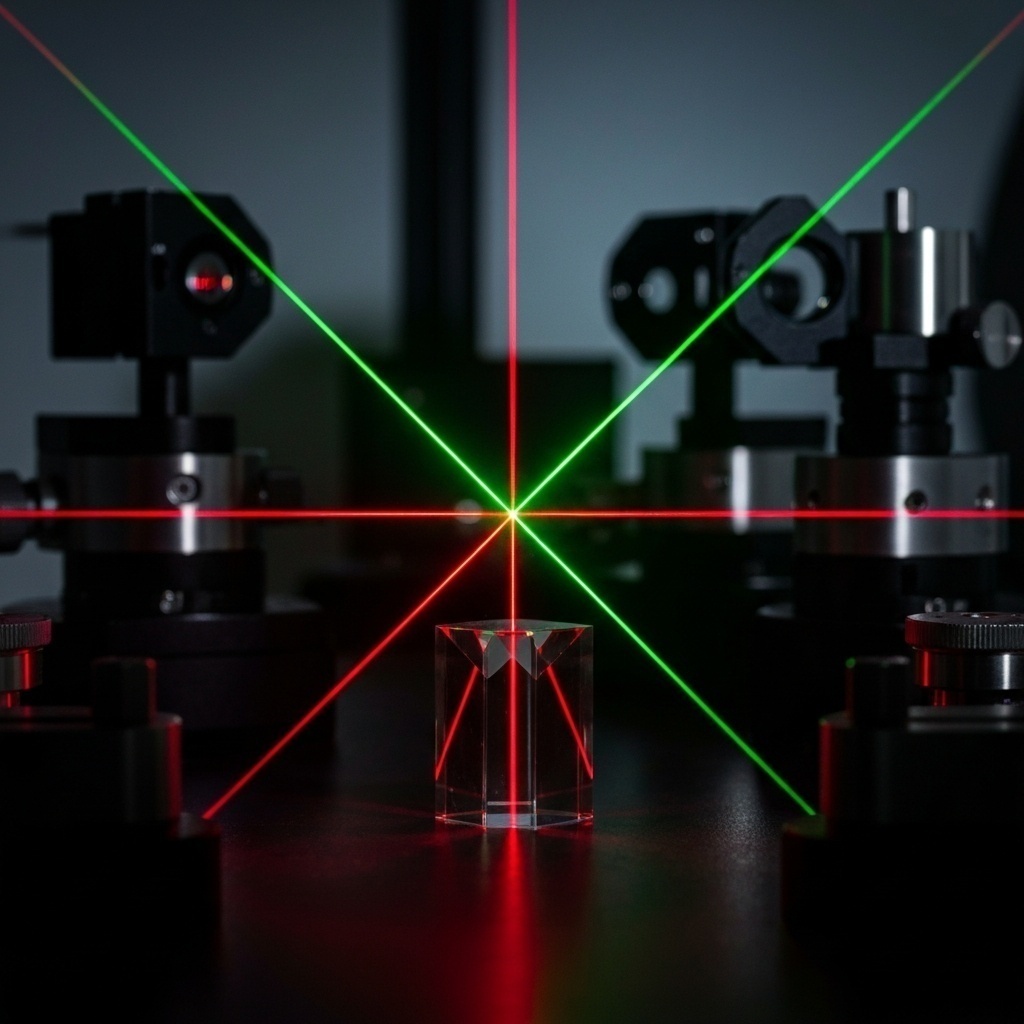

L’évolution de ces outils est intimement liée aux progrès en science des matériaux, en électronique et en informatique. Les microscopes électroniques, la métrologie laser ou les capteurs à base de MEMS (Micro-Electro-Mechanical Systems) offrent aujourd’hui des résolutions autrefois inaccessibles. Les lasers femtosecondes, par exemple, permettent une découpe sub-micronique de matériaux, ouvrant la voie à des dispositifs médicaux miniaturisés et à des composants électroniques extrêmement denses, dont l’intégrité doit être surveillée par une chaîne de mesure et de collecte de données irréprochable.

Un volet essentiel de la technologie de précision concerne le calibrage et l’étalonnage réguliers des instruments. Sans référentiels stables, même l’outil le plus sophistiqué produit des résultats trompeurs. La métrologie, science de la mesure, garantit la traçabilité des valeurs jusqu’aux étalons nationaux et internationaux. Des organismes comme le LNE en France définissent et maintiennent ces références, ce qui permet à un laboratoire, à une usine ou à un datacenter de comparer ses mesures, de documenter ses performances et d’assurer une récupération de données cohérente dans le temps.

Au-delà de la dimension matérielle, la précision repose sur les méthodes d’analyse des données. L’identification des sources d’erreur, la quantification des incertitudes et l’utilisation de modèles statistiques (par exemple la méthode des moindres carrés pour ajuster un modèle) permettent d’améliorer la qualité globale des résultats. Une donnée bien qualifiée, accompagnée de ses métadonnées et de son incertitude de mesure, sera beaucoup plus facile à interpréter, à répliquer et à restaurer lors d’une opération de récupération de données.

La compétence humaine reste enfin un maillon déterminant. Même avec des instruments de pointe, une mauvaise configuration, un protocole inadapté ou une documentation incomplète peuvent introduire des biais. La formation continue, la compréhension fine des principes de mesure et la rigueur dans l’annotation des expériences conditionnent la valeur des résultats. Chaque geste compte : choisir le bon capteur, paramétrer correctement un enregistreur, tracer les versions d’un logiciel d’acquisition facilite, en aval, le diagnostic d’incidents et la récupération fiable des données.

L’essor de la bio-impression 3D illustre parfaitement cette synergie entre outils, méthodes et expertise humaine. Des imprimantes de haute précision déposent des cellules vivantes et des biomatériaux couche par couche, avec un contrôle micrométrique de la géométrie, de la composition et de l’environnement. Chaque paramètre (température, viscosité, temps d’exposition) est mesuré et enregistré afin de pouvoir rejouer le processus, comparer les lots et retrouver l’historique en cas de défaillance. Sans cette traçabilité de haute précision, il serait pratiquement impossible de comprendre les écarts de performance ou de sécuriser les données issues de ces tissus imprimés.

Applications en Labo

Les laboratoires, qu’ils soient dédiés à la recherche fondamentale, au développement de produits ou au contrôle qualité industriel, reposent sur une technologie de précision omniprésente. Instruments de mesure, protocoles opérationnels et systèmes d’information sont conçus pour produire des résultats fiables et reproductibles. Dans ce contexte, la « récupération de données » ne se limite pas à restaurer un fichier perdu : elle englobe la capacité à retrouver l’intégralité du contexte expérimental, des métadonnées et des paramètres qui ont conduit à un résultat.

En biologie moléculaire, le séquençage de l’ADN et de l’ARN s’appuie sur la microfluidique, l’optique de haute résolution et l’automatisation robotique. La qPCR, par exemple, exige un contrôle très fin des volumes, des températures de cyclage et des temps d’incubation pour quantifier avec exactitude les acides nucléiques. Chaque cycle génère des courbes de fluorescence, des seuils (Ct) et des indicateurs de qualité qui doivent être archivés. Si ces données ou ces métadonnées sont altérées, l’interprétation clinique ou scientifique peut être faussée, et une éventuelle récupération de données devient beaucoup plus complexe.

En chimie, la synthèse de nouveaux composés et leur caractérisation mobilisent des techniques telles que la chromatographie, la spectroscopie ou la spectrométrie de masse. Une GC-MS bien étalonnée permet d’identifier et de quantifier des traces de polluants ou de contaminants à des niveaux infimes. Pour que ces résultats restent exploitables, il est indispensable d’enregistrer les conditions expérimentales (colonnes, solvants, gradients, profils de température) et les jeux de données brutes. En cas de perte, une stratégie de récupération de données devra restaurer non seulement les chromatogrammes et les spectres, mais aussi l’ensemble du contexte qui permet de les interpréter.

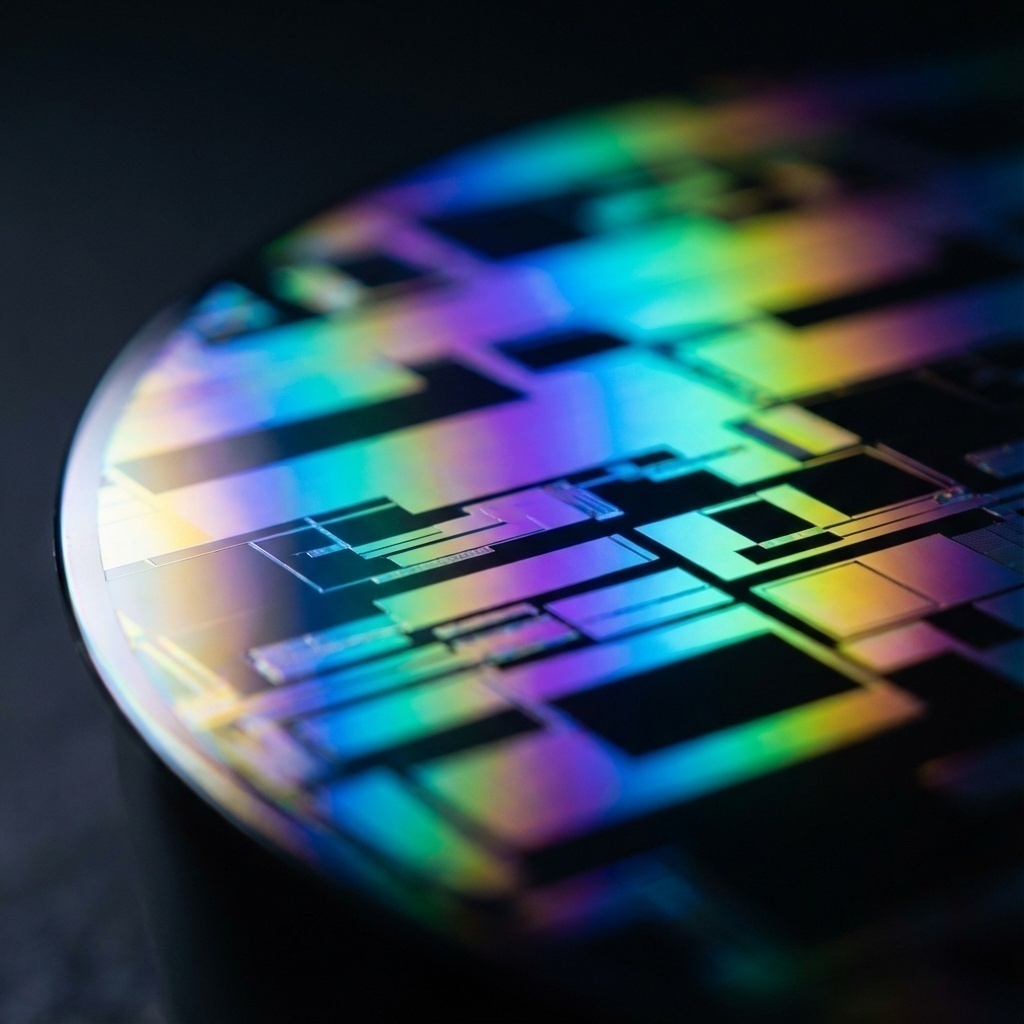

La science des matériaux repose également sur des mesures extrêmement fines : microscopie à force atomique, diffraction des rayons X ou spectroscopie d’impédance révèlent la structure et le comportement intimes d’un matériau. Dans le développement de nanomatériaux ou de dispositifs nanoélectroniques, la moindre variation de topographie ou de dopage peut modifier les performances. La conservation rigoureuse des données de caractérisation, des scripts d’analyse et des versions de logiciels est donc un prérequis pour comparer des séries d’essais, reproduire une innovation ou instruire une expertise en cas de litige.

Les laboratoires de métrologie occupent une place à part : ils assurent la continuité et la cohérence des unités de mesure à l’échelle nationale et internationale. L’établissement d’étalons de masse, de longueur, de temps ou de température impose un contrôle extrême de l’environnement (température, hygrométrie, vibrations, champs électromagnétiques). Toute la chaîne de données, des mesures primaires aux certificats d’étalonnage, doit être protégée, sauvegardée et récupérable pour garantir la confiance des industries et des régulateurs.

Dans les laboratoires modernes, la gestion du cycle de vie des données devient un sujet stratégique. Les instruments de précision produisent des volumes massifs de fichiers, parfois non structurés, qu’il faut stocker, indexer et protéger. Sans politique de sauvegarde adaptée, une panne matérielle ou une erreur humaine peut entraîner la perte irrémédiable d’années de travail expérimental.

Pour éviter ces situations, les logiciels de gestion de données de laboratoire (LIMS, ELN) structurent les informations, tandis que les méthodes d’analyse statistique et les outils de visualisation aident à en extraire des conclusions robustes. Des stratégies de sauvegarde, de redondance géographique et de récupération de données bien conçues assurent la pérennité de ce patrimoine scientifique.

La nécessité de précision influence aussi la conception physique des laboratoires. Salles blanches contrôlées en particules, systèmes de stabilisation de la température, de l’humilité et des vibrations, alimentation électrique redondante : tout est pensé pour réduire les perturbations susceptibles d’affecter une mesure ou un enregistrement. Dans un laboratoire de fabrication de semi-conducteurs, par exemple, la classe ISO de propreté et la continuité électrique conditionnent directement la qualité des puces produites et la fiabilité des données de process associées.

En combinant technologie de précision, protocoles rigoureux et expertise humaine, les laboratoires peuvent délivrer des résultats crédibles, développer des produits innovants et répondre aux exigences réglementaires les plus strictes. La valeur de la « récupération de données » réside alors dans la possibilité de rejouer l’histoire : comprendre comment un résultat a été obtenu, vérifier sa robustesse et capitaliser sur ces connaissances pour les projets futurs.

Impact Sur les Résultats

Instruments Clés

- Microscopes électroniques : ces instruments permettent d’observer des structures à l’échelle nanométrique avec une profondeur de champ et une résolution inaccessibles à l’optique classique. En science des matériaux, en biologie ou en micro-électronique, ils révèlent des défauts invisibles à l’œil nu, identifient des mécanismes de défaillance et génèrent des images numériques dont chaque pixel doit être stocké, documenté et, si besoin, récupéré sans perte d’information.

Méthodes Précises

- Étalonnage rigoureux des instruments : un programme d’étalonnage traçable, conforme à des références internationales (par exemple ISO/CEI 17025), réduit les erreurs systématiques et aléatoires. Chaque opération d’étalonnage génère des certificats, des rapports et des jeux de données qui documentent les performances réelles d’un instrument dans le temps, condition nécessaire pour valider la comparabilité des résultats et fiabiliser la récupération de données historiques.

Bénéfices

- Fiabilité des données : en maîtrisant les sources d’erreur et en documentant les incertitudes de mesure, les organisations augmentent la confiance accordée à leurs résultats. Les études deviennent plus reproductibles, les audits plus simples, et les décisions stratégiques (lancement d’un produit, déploiement d’un traitement, ajustement d’un procédé) peuvent s’appuyer sur un socle factuel solide. En cas d’incident, cette qualité métrologique facilite aussi les analyses forensiques et la récupération précise des données critiques.

La technologie de précision agit donc comme un amplificateur de qualité pour l’ensemble de la chaîne de valeur : mesure, analyse, décision, archivage. Des instruments performants associés à des méthodes rigoureuses permettent de réduire les incertitudes, d’isoler plus finement les phénomènes à l’étude et d’éviter les conclusions hâtives. En médecine, par exemple, un diagnostic plus précis rend possible une médecine personnalisée et des plans de traitement mieux adaptés, dont l’efficacité peut être suivie dans le temps grâce à une collecte et une récupération de données fiables.

La récupération de données prolonge cet impact en garantissant la pérennité des résultats. Conserver les données brutes, les scripts d’analyse, les journaux d’activité et les protocoles expérimentaux dans des formats ouverts et documentés permet à d’autres équipes de vérifier, de reproduire ou de réutiliser les travaux. L’adoption de référentiels sécurisés, de plans de sauvegarde redondants et de procédures de récupération testées régulièrement transforme les données de laboratoire ou d’usine en un capital durable, partageable et valorisable.

Conclusion

En conclusion, la technologie de précision ne se résume pas à un catalogue d’instruments de mesure de haute gamme : elle incarne une culture de l’excellence qui irrigue la recherche, l’industrie et la gestion des systèmes d’information. En réduisant les incertitudes, en améliorant la traçabilité et en structurant les données produites, elle ouvre la voie à des découvertes majeures, à des innovations technologiques et à une meilleure qualité de vie. Intimement liée à la récupération de données, cette approche garantit que les résultats obtenus aujourd’hui resteront exploitables, vérifiables et transmissibles demain.

Chez Datastrophe, nous mettons cette exigence de précision au cœur de nos services. Nos équipes combinent expertise en récupération de données, compétences en métrologie numérique et bonnes pratiques de gouvernance de l’information pour protéger votre patrimoine numérique. Qu’il s’agisse de restaurer un stockage défaillant, de sécuriser des données de laboratoire sensibles ou de déployer une stratégie de sauvegarde à long terme, nous concevons des solutions robustes, adaptées à vos enjeux réglementaires et opérationnels. Contactez-nous pour étudier vos besoins et construire une architecture de données où la précision et la résilience vont de pair.